在第四屆828 B2B企業節盛大啟幕之際,華為云傳來了一則振奮人心的消息:其Tokens服務已成功接入CloudMatrix384超節點,標志著華為云在AI算力領域邁出了重要一步。

借助xDeepServe架構的創新突破,華為云的單芯片性能實現了飛躍,達到了2400TPS的超高吞吐量和50ms的超低時延,這一表現遠遠超越了當前業界的平均水平。這一技術革新,無疑為AI應用的高效運行提供了強有力的支持。

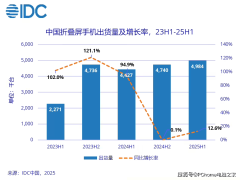

近年來,中國AI算力需求呈現出爆炸式增長。據統計,從2024年初到今年6月底,中國日均Token消耗量從1000億激增到30萬億,短短一年半時間增長了300余倍。這一數據不僅反映了我國人工智能應用規模的迅速擴張,也對算力基礎設施提出了前所未有的挑戰。

面對這一挑戰,華為云于今年3月正式推出了基于MaaS的Tokens服務。該服務不僅提供了在線版、進線版、離線版及尊享版等多種規格,以滿足不同應用和場景的性能需求,還通過靈活的計費方式,為用戶帶來了更為便捷、低成本的算力解決方案。

此次Tokens服務接入CloudMatrix384超節點,更是將性能推向了新的高度。借助384原生的xDeepServe框架,吞吐量從年初的1920TPS躍升至2400TPS,TPOT也降低至50ms。這一提升,無疑為AI工具的高效運行提供了更為堅實的算力保障。

華為云的這一成就,并非單點突破,而是從硬件到軟件、從算子到存儲、從推理框架到超節點的全方位創新。CloudMatrix384超節點以其全新的計算架構,突破了性能瓶頸,構筑了強大的算力基礎。同時,CANN昇騰硬件使能、EMS彈性內存存儲以及xDeepServe分布式推理框架等技術的協同作用,共同推動了算力的極致釋放。

作為CloudMatrix384超節點的原生服務,xDeepServe采用了Transformerless的極致分離架構,將MoE大模型拆分為可獨立伸縮的微模塊,實現了高效的算力分配和利用。通過這一架構,CloudMatrix384上的大模型被拆解成“積木”,并分配到不同的NPU上同步處理任務,從而構建了一條超高吞吐的LLM服務平臺,即Tokens的“超高速流水線”。

CANN作為硬件加速計算的中間層,包含了多個算子庫和高性能通信庫等組件,為AI模型的高效運行提供了有力支撐。其中,專為超節點上的大語言模型(LLM)服務打造的高性能通信庫XCCL,充分發揮了CloudMatrix384擴展后的UB互聯架構的潛力,為Transformerless的全面分離奠定了堅實的硬件基礎。

而FlowServe作為被重構的“去中心”式分布式引擎,則將CloudMatrix384切割成完全自治的DP小組,每個小組都具備Tokenizer、執行器、RTC緩存與網絡棧等完整功能,實現了千卡并發也不擁堵的高效運行。

目前,華為云MaaS服務已廣泛支持DeepSeek、Kimi、Qwen等主流大模型及versatile、Dify等主流Agent平臺。通過大量的模型性能優化和效果調優,華為云實現了“源于開源,高于開源”的目標,讓更多大模型能夠在昇騰云上實現更快更好的運行。

以文生圖大模型為例,在輕微損失畫質的前提下,通過Int8量化、旋轉位置編碼融合算子等方式,華為云MaaS平臺實現了出圖速度的兩倍提升,最大尺寸支持達到2K×2K。而在文生視頻大模型上,通過量化提速和通算并行等方式,視頻生成速度大幅提升,相較于友商實現了3.5倍的性能提升。

在應用層面,華為云已與超過100家合作伙伴攜手深入行業場景,共同推出了豐富的Agent解決方案。這些方案在調研分析、內容創作、智慧辦公、智能運維等領域發揮了重要作用,幫助企業更便捷地擁抱AI創新,加速智能化轉型。

例如,基于MaaS平臺推出的今日人才數智員工解決方案,集成了先進的自然語言處理、機器學習和深度學習技術,能夠智能交互并處理任務,顯著提升服務效率與客戶滿意度。而北京方寸無憂科技開發的無憂智慧公文解決方案,則通過智能化手段提升了公文處理效能,推動了政企辦公的智能化轉型。