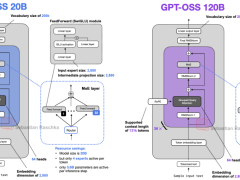

在人工智能領域,大語言模型(LLM)的演進從未停歇,盡管整體架構自GPT-2以來并未發生根本性變化。近日,Sebastian Raschka博士通過深入分析OpenAI開源的gpt-oss模型(包括120B和20B版本),帶領讀者回顧了從GPT-2到gpt-oss的技術演進之路,并將gpt-oss與另一開源模型Qwen3進行了詳細對比。

8月5日,就在GPT-5發布的前兩天,OpenAI宣布推出兩款開源大語言模型:gpt-oss-120b和gpt-oss-20b。這是自2019年GPT-2發布以來,OpenAI首次開放模型權重,且得益于巧妙的優化技術,這些模型甚至可以在本地設備上運行。

Raschka博士在其文章《從GPT-2到gpt-oss:架構進步分析》中,詳細解析了從GPT-2到gpt-oss的架構演進。他指出,盡管兩者在整體架構上相似,但gpt-oss在多個細節上進行了優化,如移除Dropout、采用RoPE替代絕對位置編碼、激活函數從GELU轉向Swish/SwiGLU等。

首先,Dropout技術雖然在早期Transformer架構中被廣泛使用,但現代LLM發現其并不能顯著提升性能,反而可能因單輪訓練模式導致下游任務表現下降。因此,gpt-oss選擇了移除Dropout。

其次,在位置編碼方面,gpt-oss采用了RoPE(旋轉位置嵌入)替代傳統的絕對位置嵌入。RoPE通過對query和key向量施加位置相關的旋轉來編碼位置信息,這種方式更加高效且逐漸成為LLM的標配。

在激活函數的選擇上,gpt-oss從GELU轉向了Swish/SwiGLU。Swish的計算成本略低于GELU,且在實踐中表現良好,盡管兩者在建模性能上的差異并不顯著。

更重要的是,gpt-oss對前饋網絡模塊進行了重構,引入了帶門控的GLU(Gated Linear Unit)變體,如SwiGLU。這種結構不僅性能更好,而且總參數量更少,通過門控帶來的額外乘法交互增強了模型的表達能力。

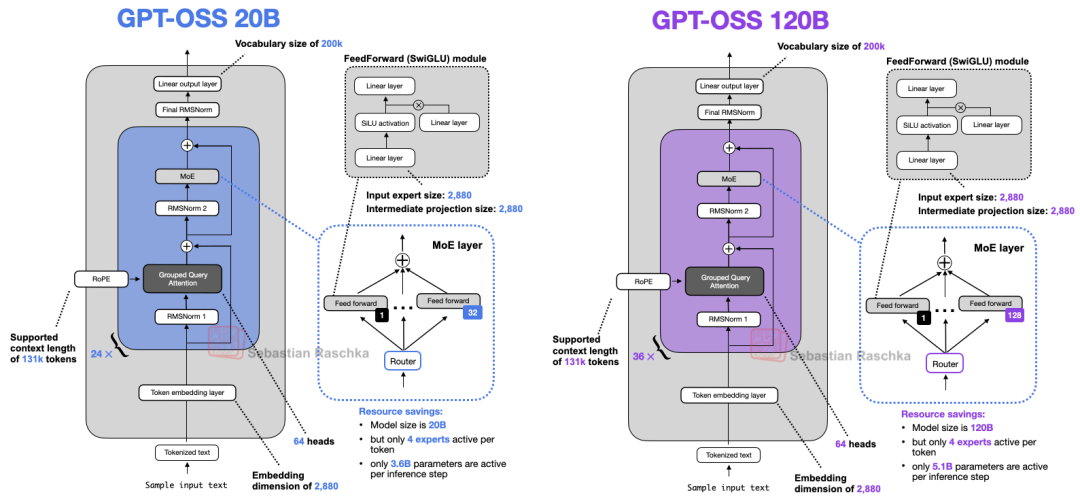

gpt-oss還采用了Mixture-of-Experts(MoE,專家混合)技術,用多個前饋模塊替代單個前饋模塊,并在每個token生成步驟中只啟用其中一個子集。這種做法顯著增加了模型的總參數量,但通過稀疏性在推理階段保持了高效率。

在注意力機制方面,gpt-oss引入了分組查詢注意力(GQA)替代傳統的多頭注意力(MHA),并通過滑動窗口注意力進一步降低內存占用和計算成本。同時,gpt-oss還用RMSNorm替代了LayerNorm,以提升訓練效率。

在與Qwen3的對比中,gpt-oss展現出不同的設計思路。Qwen3是一個更深的架構,而gpt-oss則更寬。在MoE的使用上,gpt-oss采用了少量“大專家”策略,而Qwen3則傾向于更多、更小的專家。gpt-oss在注意力機制中引入了偏置項和注意力池,以穩定注意力機制。

在性能方面,gpt-oss與OpenAI自研的閉源模型以及Qwen3相當。盡管gpt-oss在某些任務上可能表現出較高的幻覺傾向,但其作為推理型模型的設計,使其在成本、算力和準確度之間找到了良好的平衡。

隨著gpt-oss的開源,更多開發者將能夠利用這一強大工具進行本地或私有化部署,推動人工智能技術在各領域的廣泛應用。