近日,AI領(lǐng)域的創(chuàng)新企業(yè)Anthropic對外宣布了一項重要進展,該公司于5月29日通過官方渠道發(fā)布了一款名為“Circuit Tracer”的開源工具。這款工具旨在通過圖形化的方式,直觀展示AI大語言模型內(nèi)部的思維流程,為研究人員提供了一扇透視AI“黑箱”的新窗口。

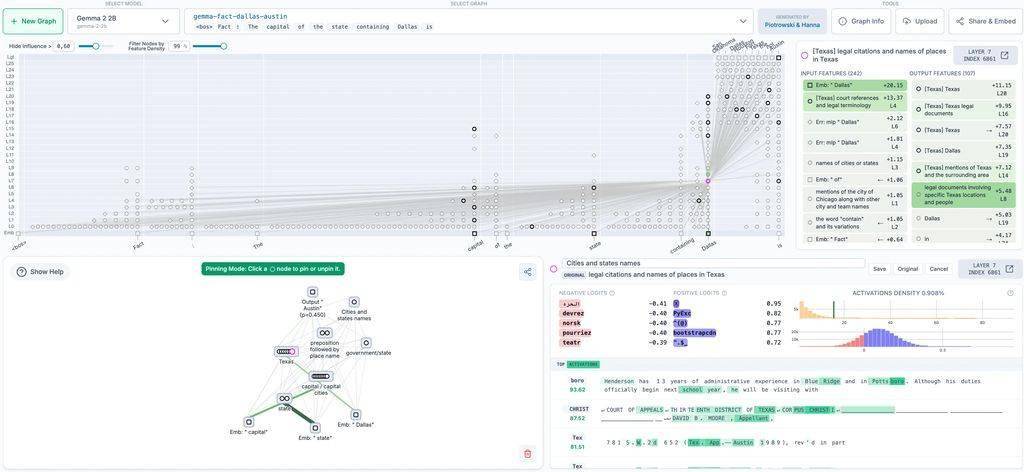

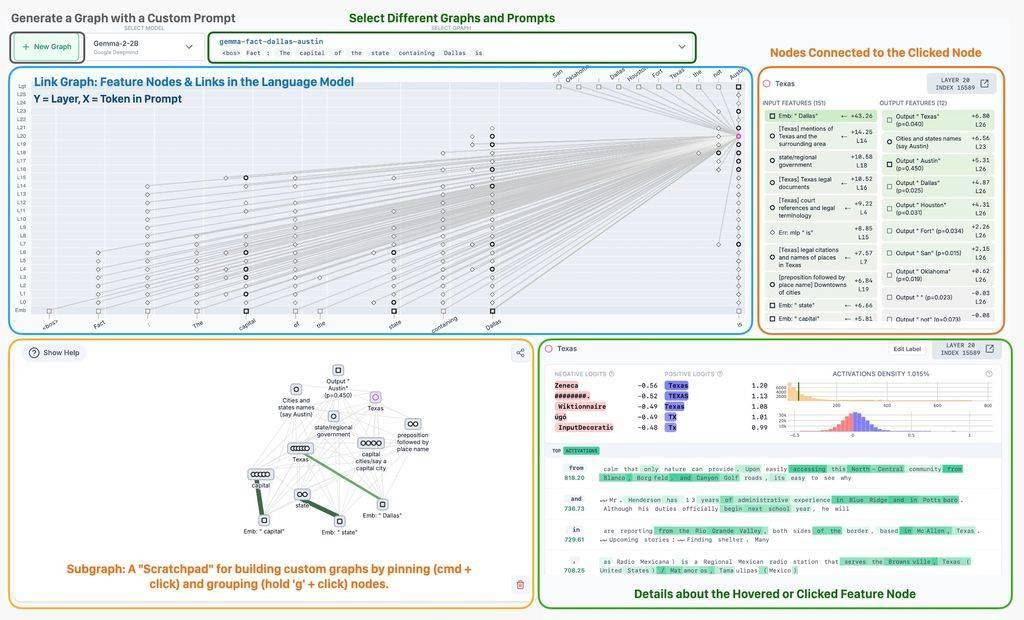

Circuit Tracer的核心功能在于構(gòu)建所謂的“歸因圖”(Attribution Graph),這一圖形化工具能夠助力研究者深入探究AI模型的內(nèi)部工作機制,并以交互式的方式進行探索。這一項目的推進,得益于Anthropic Fellows程序參與者與專注于AI解釋性研究的Decode Research團隊的緊密合作,雙方共同致力于提升AI的安全性。

目前,Circuit Tracer已在GitHub平臺以開源庫的形式公開發(fā)布,用戶可以通過Decode Research運營的Neuronpedia平臺,輕松訪問其交互式前端,并查看生成的歸因圖。這一舉措無疑為AI研究者提供了極大的便利,使他們能夠更加直觀地理解和分析AI模型的內(nèi)部邏輯。

借助Circuit Tracer,用戶不僅能夠生成自定義的歸因圖,追蹤AI模型內(nèi)部的決策路徑,還能對生成的圖形進行標(biāo)注、分享,甚至通過調(diào)整特征值來觀察模型輸出的變化。這一功能為驗證研究假設(shè)、優(yōu)化模型性能提供了有力的支持。

Anthropic在發(fā)布聲明中強調(diào),盡管AI技術(shù)的功能進步日新月異,但人們對于AI內(nèi)部結(jié)構(gòu)的理解卻遠遠滯后。因此,開源Circuit Tracer這樣的工具,對于推動AI技術(shù)的透明化和可解釋性具有重要意義。這不僅有助于更廣泛的社區(qū)深入探究語言模型的內(nèi)部運作,理解模型行為,還為工具的進一步改進和擴展提供了無限可能。